理解多站点robots.txt的特殊性

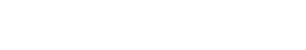

WordPress多站点网络(Multisite)是一个强大的功能,允许您从单个WordPress安装运行多个网站。然而,这种架构在robots.txt配置上带来了独特的挑战和考虑因素。

多站点robots.txt的核心特性

- 集中管理,独立控制:网络管理员可设置全局规则,各子站点可自定义

- URL结构复杂性:子域名 vs 子目录结构的不同处理

- 搜索引擎索引策略:统一索引 vs 独立索引的选择

- 安全考量:防止敏感路径暴露,保护网络结构

一、多站点架构下的robots.txt基础

1. 多站点安装类型对robots.txt的影响

子域名安装(例如:site1.example.com, site2.example.com)

- 每个子域名有独立的robots.txt

- 搜索引擎视为完全独立的网站

- 需要为每个站点单独配置

子目录安装(例如:example.com/site1/, example.com/site2/)

- 主站点和子站点共享根目录robots.txt

- 但可通过特殊规则针对性控制

- 更复杂的路径匹配需求

2. 默认多站点robots.txt分析

WordPress多站点默认生成:

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php默认设置的局限性:

- 过于简单,缺乏针对性

- 未考虑子站点特性

- 缺乏现代搜索引擎指令

- 可能暴露敏感信息

二、robots.txt配置策略

1. 网络级全局配置

适用于所有站点的基本规则:

User-agent: *

Crawl-delay: 2

Request-rate: 1/10

# 保护WordPress核心文件

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /wp-content/plugins/

Disallow: /wp-content/themes/

Disallow: /wp-content/upgrade/

Disallow: /wp-json/

Disallow: /xmlrpc.php

Disallow: /wp-login.php

Disallow: /wp-signup.php

Disallow: /wp-trackback.php

Disallow: /feed/

Disallow: /comments/feed/

Disallow: /*/feed/

Disallow: /?s=

Disallow: /*/?s=

Disallow: /*?*

Disallow: /*.php$

# 允许必要文件

Allow: /wp-admin/admin-ajax.php

Allow: /wp-admin/load-styles.php

Allow: /wp-admin/load-scripts.php

Allow: /wp-content/uploads/

Allow: /wp-content/themes/*/assets/

Allow: /wp-content/plugins/*/assets/

# 站点地图声明

Sitemap: https://example.com/wp-sitemap.xml2. 子域名多站点配置

每个子站点的独立robots.txt:

主站点(example.com):

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Disallow: /wp-includes/

Allow: /wp-includes/js/

Allow: /wp-includes/css/

# 主站点特定规则

Disallow: /private-area/

Disallow: /staging/

Sitemap: https://example.com/wp-sitemap.xml

Sitemap: https://example.com/wp-sitemap-posts-post-1.xml

Sitemap: https://example.com/wp-sitemap-pages-page-1.xml子站点1(site1.example.com):

User-agent: *

Crawl-delay: 3

# 继承网络级规则

Disallow: /wp-admin/

Disallow: /wp-includes/

# 子站点特定规则

Disallow: /members-only/

Disallow: /draft-content/

Allow: /public-resources/

# 子站点专用站点地图

Sitemap: https://site1.example.com/wp-sitemap.xml子站点2(blog.example.com):

User-agent: *

Crawl-delay: 1

# 搜索引擎特定规则

User-agent: Googlebot

Allow: /feed/

Allow: /comments/feed/

Disallow: /private/

Disallow: /drafts/

User-agent: Googlebot-News

Allow: /

User-agent: Googlebot-Image

Allow: /wp-content/uploads/

Disallow: /private-images/

User-agent: Bingbot

Crawl-delay: 2

Disallow: /members/

# 博客特定规则

Allow: /*.css$

Allow: /*.js$

Allow: /*.png$

Allow: /*.jpg$

Allow: /*.gif$

Allow: /*.svg$

Sitemap: https://blog.example.com/wp-sitemap.xml3. 子目录多站点配置

共享robots.txt的智能规则:

User-agent: *

# 全局禁止

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /wp-content/plugins/

Disallow: /wp-content/themes/

Disallow: /cgi-bin/

# 子站点特定控制

# 允许主站点

Allow: /$

Allow: /page/

Allow: /category/

Allow: /tag/

# 子站点1:example.com/site1/

Allow: /site1/

Disallow: /site1/wp-admin/

Disallow: /site1/private/

Allow: /site1/wp-content/uploads/

# 子站点2:example.com/blog/

Allow: /blog/

Disallow: /blog/wp-admin/

Disallow: /blog/drafts/

Allow: /blog/feed/

Allow: /blog/comments/feed/

# 子站点3:example.com/store/ (需要更多限制)

Allow: /store/

Disallow: /store/checkout/

Disallow: /store/cart/

Disallow: /store/my-account/

Disallow: /store/wp-admin/

# 动态内容控制

Disallow: /*?replytocom=

Disallow: /*?utm_

Disallow: /*?sessionid=

Disallow: /*?sort=

Disallow: /*?filter_

# 文件类型控制

Allow: /*.css$

Allow: /*.js$

Allow: /*.png$

Allow: /*.jpg$

Allow: /*.gif$

Allow: /*.svg$

Allow: /*.webp$

Disallow: /*.php$

Disallow: /*.sql$

Disallow: /*.log$

# 站点地图 - 每个子站点单独声明

Sitemap: https://example.com/wp-sitemap.xml

Sitemap: https://example.com/site1/wp-sitemap.xml

Sitemap: https://example.com/blog/wp-sitemap.xml

Sitemap: https://example.com/store/wp-sitemap.xml三、技术实现方案

1. 通过.htaccess动态生成

子目录多站点的智能robots.txt:

# 在.htaccess中添加

RewriteEngine On

# 动态robots.txt

RewriteCond %{REQUEST_URI} ^/robots\.txt$

RewriteCond %{HTTP_HOST} ^site1\.example\.com$ [NC]

RewriteRule ^(.*)$ /robots-site1.txt [L]

RewriteCond %{REQUEST_URI} ^/robots\.txt$

RewriteCond %{HTTP_HOST} ^site2\.example\.com$ [NC]

RewriteRule ^(.*)$ /robots-site2.txt [L]

# 默认robots.txt

RewriteCond %{REQUEST_URI} ^/robots\.txt$

RewriteRule ^(.*)$ /robots-default.txt [L]对应的robots文件:

# robots-site1.txt

User-agent: *

Disallow: /wp-admin/

Allow: /wp-content/uploads/site1/

Sitemap: https://site1.example.com/wp-sitemap.xml

# robots-site2.txt

User-agent: *

Disallow: /wp-admin/

Disallow: /private/

Sitemap: https://site2.example.com/wp-sitemap.xml2. 通过PHP动态生成

动态robots.txt生成器:

<?php

// 保存为 /robots.php

header('Content-Type: text/plain; charset=utf-8');

$host = $_SERVER['HTTP_HOST'];

$request_uri = $_SERVER['REQUEST_URI'];

// 基础规则

$robots = "User-agent: *\n";

$robots .= "Crawl-delay: 2\n\n";

// 根据子站点定制规则

if (strpos($host, 'site1.') !== false) {

// 子站点1规则

$robots .= "# 子站点1特定规则\n";

$robots .= "Disallow: /members/\n";

$robots .= "Allow: /public/\n";

$robots .= "Sitemap: https://site1.example.com/wp-sitemap.xml\n";

} elseif (strpos($host, 'site2.') !== false) {

// 子站点2规则

$robots .= "# 子站点2特定规则\n";

$robots .= "Disallow: /private-area/\n";

$robots .= "Allow: /resources/\n";

$robots .= "Sitemap: https://site2.example.com/wp-sitemap.xml\n";

} elseif (strpos($request_uri, '/blog/') !== false) {

// 子目录博客

$robots .= "# 博客子目录规则\n";

$robots .= "Disallow: /blog/wp-admin/\n";

$robots .= "Allow: /blog/feed/\n";

$robots .= "Sitemap: https://example.com/blog/wp-sitemap.xml\n";

} else {

// 主站点默认规则

$robots .= "# 主站点规则\n";

$robots .= "Disallow: /wp-admin/\n";

$robots .= "Disallow: /staging/\n";

$robots .= "Sitemap: https://example.com/wp-sitemap.xml\n";

}

// 添加公共规则

$robots .= "\n# 公共规则\n";

$robots .= "Disallow: /wp-includes/\n";

$robots .= "Disallow: /wp-content/plugins/\n";

$robots .= "Allow: /wp-content/uploads/\n";

$robots .= "Allow: /wp-content/themes/*/assets/\n";

echo $robots;

?>.htaccess中重定向到PHP:

RewriteEngine On

RewriteRule ^robots\.txt$ /robots.php [L]3. WordPress插件解决方案

推荐多站点robots.txt插件:

| 插件名称 | 多站点支持 | 主要功能 | 推荐场景 |

|---|---|---|---|

| All in One SEO | ✅ 完全支持 | 可视化编辑器,站点地图集成 | 企业级多站点 |

| Yoast SEO Premium | ✅ 需要Premium | 高级控制,模式分析 | SEO专业团队 |

| SEOPress | ✅ 完全支持 | 简单易用,模式模板 | 中小型网络 |

| Robots.txt Editor | ⚠️ 有限支持 | 纯robots编辑,轻量级 | 简单需求 |

使用All in One SEO配置示例:

// 网络激活后,在每个子站点设置

// 网络管理员可设置默认模板

// 子站点管理员可覆盖特定规则

// 示例:网络级默认模板

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-includes/

Allow: /wp-content/uploads/

Sitemap: {site_url}/sitemap.xml

// 子站点可添加:

Disallow: /private-{site_slug}/

Allow: /public-{site_slug}/四、搜索引擎特定配置

1. Google搜索引擎优化

# Google特定规则

User-agent: Googlebot

Allow: /wp-content/uploads/

Disallow: /wp-admin/

Disallow: /search/

Crawl-delay: 1

User-agent: Googlebot-Image

Allow: /wp-content/uploads/

Allow: /*.jpg$

Allow: /*.png$

Allow: /*.gif$

Allow: /*.webp$

Disallow: /wp-content/uploads/private/

User-agent: Googlebot-News

Allow: /

Disallow: /wp-admin/

Disallow: /drafts/

User-agent: Googlebot-Video

Allow: /wp-content/uploads/videos/

Disallow: /wp-content/uploads/private-videos/

# 移动搜索引擎

User-agent: Googlebot-Mobile

Allow: /

Crawl-delay: 2

# 广告机器人

User-agent: AdsBot-Google

Allow: /

Disallow: /checkout/

Disallow: /cart/2. 百度搜索引擎配置

# 百度特定规则

User-agent: Baiduspider

Allow: /wp-content/uploads/

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /search/

Crawl-delay: 3

Request-rate: 1/5

User-agent: Baiduspider-image

Allow: /wp-content/uploads/

Allow: /*.jpg$

Allow: /*.png$

Allow: /*.gif$

Disallow: /private-images/

User-agent: Baiduspider-video

Allow: /wp-content/uploads/videos/

Disallow: /private-videos/

User-agent: Baiduspider-news

Allow: /

Disallow: /wp-admin/

# 百度站内搜索

User-agent: Baiduspider-favo

Disallow: /

# 百度移动搜索

User-agent: Baiduspider-mobile

Allow: /

Crawl-delay: 23. 其他主流搜索引擎

# Bing

User-agent: bingbot

Allow: /wp-content/uploads/

Disallow: /wp-admin/

Disallow: /search/

Crawl-delay: 2

# Yandex

User-agent: Yandex

Allow: /wp-content/uploads/

Disallow: /wp-admin/

Disallow: /search/

Clean-param: ref /search/

Clean-param: utm_source&utm_medium&utm_campaign

# DuckDuckGo

User-agent: DuckDuckBot

Allow: /

Disallow: /wp-admin/

Crawl-delay: 1

# 社交媒体爬虫

User-agent: Twitterbot

Allow: /

Disallow: /wp-admin/

User-agent: facebookexternalhit

Allow: /

Disallow: /wp-admin/

Crawl-delay: 1

# 通用规则

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-includes/

Allow: /wp-content/uploads/五、多站点特殊情况处理

1. 开发/测试环境控制

# 开发环境 - 完全禁止收录

User-agent: *

Disallow: /

# 测试环境 - 有限访问

User-agent: *

Disallow: /

Allow: /wp-content/uploads/test/

# 预发布环境

User-agent: *

Disallow: /

Allow: /$ # 只允许首页

Allow: /page/about/

Allow: /page/contact/

# 密码保护站点

User-agent: *

Disallow: /

Allow: /wp-content/uploads/public/2. 多语言站点处理

# 多语言子站点 - 中文站

User-agent: *

Disallow: /zh/wp-admin/

Allow: /zh/

Allow: /zh/page/

Allow: /zh/post/

Disallow: /zh/private/

Sitemap: https://example.com/zh/wp-sitemap.xml

# 英文站

User-agent: *

Disallow: /en/wp-admin/

Allow: /en/

Allow: /en/page/

Allow: /en/post/

Disallow: /en/drafts/

Sitemap: https://example.com/en/wp-sitemap.xml

# 语言切换页面

Disallow: /language-switcher/

Disallow: /*?lang=

Disallow: /*?language=3. 电子商务多站点

# 主商城站点

User-agent: *

Allow: /product/

Allow: /category/

Allow: /wp-content/uploads/products/

Disallow: /checkout/

Disallow: /cart/

Disallow: /my-account/

Disallow: /wp-admin/

Disallow: /private-products/

# 特定搜索引擎规则

User-agent: Googlebot

Allow: /product/*.html

Disallow: /product/*.html?add-to-cart=

User-agent: Bingbot

Allow: /category/

Disallow: /category/*?filter=

# 图片搜索引擎

User-agent: Googlebot-Image

Allow: /wp-content/uploads/products/

Disallow: /wp-content/uploads/products/private/

# 价格比较网站

User-agent: Pricespy

Allow: /product/

Allow: /category/

Disallow: /checkout/

# 社交媒体

User-agent: Pinterest

Allow: /product/

Allow: /wp-content/uploads/products/

Crawl-delay: 1六、高级技巧与优化

1. 动态内容控制

# 分页控制

Disallow: /*?paged=

Disallow: /*?page=

Allow: /page/2/

Allow: /page/3/

# 排序和过滤

Disallow: /*?orderby=

Disallow: /*?sort=

Disallow: /*?filter_

Disallow: /*?min_price=

Disallow: /*?max_price=

# 会话和跟踪参数

Disallow: /*?sessionid=

Disallow: /*?PHPSESSID=

Disallow: /*?utm_source

Disallow: /*?ref=

Disallow: /*?affiliate_id=

# AJAX请求

Disallow: /*?ajax=

Disallow: /*?action=

Disallow: /wp-admin/admin-ajax.php?action=

# 搜索参数

Disallow: /?s=

Disallow: /*/?s=

Allow: /search/page/2. 性能优化规则

# 限制爬取频率

User-agent: *

Crawl-delay: 2

Request-rate: 1/5

# 文件类型优化

Allow: /*.css$

Allow: /*.js$

Allow: /*.jpg$

Allow: /*.png$

Allow: /*.gif$

Allow: /*.webp$

Allow: /*.svg$

Disallow: /*.php$

Disallow: /*.log$

Disallow: /*.sql$

Disallow: /*.zip$

Disallow: /*.tar.gz$

# 目录深度控制

Disallow: /*/*/*/*/*/*/ # 限制6级深度

Allow: /*/*/*/*/*/ # 允许5级深度

# 时间控制

User-agent: *

# 高峰时段限制

# 00:00-06:00 宽松

# 06:00-18:00 一般

# 18:00-24:00 严格3. 安全强化规则

# 敏感路径保护

Disallow: /wp-config.php

Disallow: /wp-config-sample.php

Disallow: /license.txt

Disallow: /readme.html

Disallow: /debug.log

Disallow: /error_log

Disallow: /.htaccess

Disallow: /.htpasswd

Disallow: /.git/

Disallow: /.svn/

Disallow: /.env

Disallow: /composer.json

Disallow: /package.json

# 备份文件保护

Disallow: /*.bak$

Disallow: /*.backup$

Disallow: /*.old$

Disallow: /*.temp$

Disallow: /backup/

Disallow: /backups/

Disallow: /database-backup/

# 管理员区域

Disallow: /wp-admin/

Disallow: /admin/

Disallow: /administrator/

Disallow: /dashboard/

Disallow: /controlpanel/

# 登录页面

Disallow: /wp-login.php

Disallow: /login/

Disallow: /signin/

Disallow: /wp-signup.php

Disallow: /register/七、验证与测试

1. 验证工具使用

Google Search Console测试:

- 登录Search Console

- 选择相应网站版本(http/https, www/non-www)

- 进入”robots.txt测试工具”

- 测试各个子站点的robots.txt

- 验证站点地图可访问性

命令行测试:

# 测试主站点

curl -A "Googlebot" https://example.com/robots.txt

# 测试子域名站点

curl -A "Bingbot" https://site1.example.com/robots.txt

# 测试特定规则

curl -A "Googlebot" -I https://example.com/wp-admin/

# 批量测试多个站点

sites=("example.com" "site1.example.com" "site2.example.com")

for site in "${sites[@]}"; do

echo "Testing: $site"

curl -s "https://$site/robots.txt" | head -20

echo "---"

done在线验证工具:

- Google Robots Testing Tool

- Bing Webmaster Tools

- Screaming Frog SEO Spider

- Ahrefs Site Audit

- SEMrush Site Audit

2. 常见问题检测

<?php

// robots.txt验证脚本

function validate_multisite_robots() {

$sites = get_sites(array('number' => 0));

$issues = array();

foreach ($sites as $site) {

switch_to_blog($site->blog_id);

$robots_url = get_home_url() . '/robots.txt';

$response = wp_remote_get($robots_url);

if (is_wp_error($response)) {

$issues[$site->blog_id] = '无法访问robots.txt';

continue;

}

$content = wp_remote_retrieve_body($response);

// 检查常见问题

if (strpos($content, 'Disallow:') === false) {

$issues[$site->blog_id] = '缺少Disallow规则';

}

if (strpos($content, 'Sitemap:') === false) {

$issues[$site->blog_id] = '缺少Sitemap声明';

}

if (strpos($content, 'User-agent: *') === false) {

$issues[$site->blog_id] = '缺少通用User-agent规则';

}

restore_current_blog();

}

return $issues;

}

?>八、最佳实践总结

1. 多站点robots.txt管理原则

分层管理策略:

- 网络级:基础安全规则,公共文件控制

- 站点级:特定内容控制,搜索引擎策略

- 页面级:敏感页面保护,特殊需求处理

版本控制:

# robots.txt版本控制示例

robots/

├── network/

│ ├── base.txt # 网络基础规则

│ ├── security.txt # 安全规则

│ └── performance.txt # 性能规则

├── sites/

│ ├── main.txt # 主站点规则

│ ├── site1.txt # 子站点1规则

│ ├── site2.txt # 子站点2规则

│ └── templates/ # 规则模板

│ ├── blog.txt # 博客模板

│ ├── shop.txt # 商店模板

│ └── corporate.txt # 企业站模板

└── generators/

├── dynamic.php # 动态生成器

└── builder.js # 规则构建工具2. 定期维护清单

月度检查:

- [ ] robots.txt可访问性

- [ ] 站点地图可访问性

- [ ] 搜索引擎爬取错误

- [ ] 新内容类型的收录情况

季度审计:

- [ ] 规则有效性验证

- [ ] 性能影响评估

- [ ] 安全规则更新

- [ ] 搜索引擎政策变更

年度审查:

- [ ] 整体策略评估

- [ ] 新技术适应

- [ ] 竞争对手分析

- [ ] 行业最佳实践更新

3. 应急响应计划

发现问题时:

- 立即备份当前robots.txt

- 使用临时允许规则恢复收录

- 分析问题根源

- 实施修复方案

- 验证修复效果

- 监控恢复情况

变更管理:

- 测试环境先行验证

- 分阶段灰度发布

- 密切监控爬取行为

- 准备快速回滚方案

结论

WordPress多站点的robots.txt管理需要系统化的策略和精细化的控制。关键在于理解多站点架构的特性,针对不同类型的站点实施适当的控制策略,并建立持续维护机制。

核心要点回顾:

- 架构认知:明确子域名和子目录架构的不同处理方式

- 分层控制:网络级、站点级、页面级的分层管理

- 动态适应:根据站点特性和需求动态生成规则

- 持续验证:定期测试和验证规则的有效性

- 安全优先:保护敏感路径,防止信息泄露

最后建议:从简单的规则开始,逐步完善,始终保持对搜索引擎爬取行为的监控。一个好的robots.txt策略应该像优秀的城市规划——既要有宏观的布局,又要有细节的雕琢,最终目的是让搜索引擎这个”访客”能够高效、安全地探索您的多站点网络。

湘公网安备43020002000238

湘公网安备43020002000238