一、robots.txt基础概念与重要性

1.1 什么是robots.txt?

robots.txt是一个简单的文本文件,位于网站根目录(如:https://www.example.com/robots.txt),用于指示搜索引擎爬虫(如Googlebot、Bingbot等)如何爬取网站内容。它是Robots Exclusion Protocol(机器人排除协议)的核心实现。

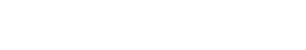

1.2 WordPress中robots.txt的特殊性

WordPress默认会自动生成一个虚拟的robots.txt文件,但这通常不是最佳实践。理想情况下,应该创建一个物理的robots.txt文件以获得更好的控制和灵活性。

二、WordPress默认robots.txt分析

2.1 WordPress自动生成的robots.txt

访问一个没有自定义robots.txt的WordPress网站,通常会看到类似这样的内容:

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php代码解析:

// WordPress默认的robots.txt规则

# User-agent: * # 适用于所有爬虫

# Disallow: /wp-admin/ # 禁止爬取后台目录

# Allow: /wp-admin/admin-ajax.php # 允许特定的AJAX文件2.2 默认规则的局限性

WordPress默认规则过于简单,缺乏:

- 对重要页面的优化指令

- 对资源文件(CSS/JS)的爬取控制

- 站点地图引用

- 爬取延迟设置

- 搜索引擎特定规则

三、创建优化的WordPress robots.txt文件

3.1 基本robots.txt创建方法

方法一:通过FTP/文件管理器创建

# 步骤:

1. 使用文本编辑器(如Notepad++、VS Code)创建新文件

2. 输入robots.txt内容

3. 通过FTP客户端上传到网站根目录

4. 确认文件权限为644方法二:通过WordPress插件创建

// 使用Yoast SEO插件自动生成

function yoast_generate_robots() {

if (class_exists('WPSEO_Robots')) {

$robots = new WPSEO_Robots();

return $robots->robots();

}

}方法三:通过主题functions.php创建

// 在functions.php中添加自定义robots.txt

function custom_robots_txt($output, $public) {

if ($public == 1) {

$custom_rules = "

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /wp-content/plugins/

Disallow: /wp-content/themes/

Allow: /wp-admin/admin-ajax.php

Allow: /wp-admin/admin-post.php

Allow: /wp-content/uploads/

Sitemap: " . get_site_url() . "/sitemap_index.xml";

return $custom_rules;

}

return $output;

}

add_filter('robots_txt', 'custom_robots_txt', 10, 2);3.2 完整的WordPress优化robots.txt模板

# ============================================

# WordPress网站优化robots.txt文件

# 生成时间: 2024年

# 网站: example.com

# ============================================

# 全局规则 - 适用于所有爬虫

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /wp-content/plugins/

Disallow: /wp-content/themes/

Disallow: /wp-json/

Disallow: /xmlrpc.php

Disallow: /feed/

Disallow: /comments/feed/

Disallow: /trackback/

Disallow: /wp-login.php

Disallow: /wp-signup.php

Disallow: /wp-register.php

Disallow: /wp-config.php

Disallow: /readme.html

Disallow: /license.txt

Disallow: /search/

Disallow: /?s=

Disallow: /page/*/*/

Disallow: /author/

Disallow: /tag/*/feed/

Disallow: /category/*/feed/

Disallow: /*/feed/

Disallow: /*/feed/rss/

Disallow: /*/feed/rss2/

Disallow: /*/*/feed/

# 允许爬取的重要文件

Allow: /wp-admin/admin-ajax.php

Allow: /wp-admin/admin-post.php

Allow: /wp-content/uploads/

Allow: /wp-content/themes/*/assets/

Allow: /wp-content/themes/*/css/

Allow: /wp-content/themes/*/js/

# 爬取延迟设置

Crawl-delay: 2

# 站点地图

Sitemap: https://www.example.com/sitemap_index.xml

Sitemap: https://www.example.com/post-sitemap.xml

Sitemap: https://www.example.com/page-sitemap.xml

Sitemap: https://www.example.com/category-sitemap.xml

Sitemap: https://www.example.com/tag-sitemap.xml

Sitemap: https://www.example.com/author-sitemap.xml

# ============================================

# 搜索引擎特定规则

# ============================================

# Googlebot

User-agent: Googlebot

Disallow: /private/

Disallow: /confidential/

Allow: /wp-content/uploads/

Crawl-delay: 1

# Googlebot-Image

User-agent: Googlebot-Image

Allow: /wp-content/uploads/

Disallow: /wp-content/plugins/

Disallow: /wp-content/themes/

# Bingbot

User-agent: Bingbot

Disallow: /cgi-bin/

Disallow: /private/

Crawl-delay: 2

# Baiduspider

User-agent: Baiduspider

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /wp-content/plugins/

Disallow: /feed/

Disallow: /comments/feed/

Crawl-delay: 5

# Yandex

User-agent: YandexBot

Disallow: /private/

Crawl-delay: 3

Clean-param: ref /search/

# DuckDuckBot

User-agent: DuckDuckBot

Disallow: /private/

Crawl-delay: 1

# 社交媒体爬虫

User-agent: facebookexternalhit

Disallow: /wp-admin/

Disallow: /wp-includes/

Allow: /wp-content/uploads/

Crawl-delay: 2

User-agent: Twitterbot

Disallow: /wp-admin/

Allow: /wp-content/uploads/

Crawl-delay: 2

# 恶意爬虫屏蔽

User-agent: AhrefsBot

Disallow: /

Crawl-delay: 10

User-agent: SemrushBot

Disallow: /

Crawl-delay: 10

User-agent: MJ12bot

Disallow: /

Crawl-delay: 10

User-agent: DotBot

Disallow: /

Crawl-delay: 10

User-agent: MegaIndex

Disallow: /

# 开发/测试环境规则

# 如果网站处于开发或测试环境

# User-agent: *

# Disallow: /四、高级robots.txt规则详解

4.1 路径模式匹配规则

# 精确路径匹配

Disallow: /private-page.html

# 目录匹配(禁止整个目录)

Disallow: /private/

# 通配符匹配

Disallow: /*.php$ # 禁止所有php文件

Disallow: /wp-*.php # 禁止所有wp-开头的php文件

Disallow: /*/feed/ # 禁止所有feed目录

Disallow: /*?s= # 禁止搜索页面

# 正则表达式模式(部分搜索引擎支持)

Disallow: /category/[0-9]+/ # 禁止数字分类

Disallow: /*.png$ # 禁止所有PNG图片

Disallow: /tag/*/page/ # 禁止标签分页4.2 Allow与Disallow的优先级

# 规则解析顺序:搜索引擎从上到下读取

# 更具体的规则优先于通用规则

# 示例1:允许uploads目录下的图片

Disallow: /wp-content/ # 禁止整个目录

Allow: /wp-content/uploads/ # 但允许uploads子目录

Allow: /wp-content/uploads/*.jpg$ # 更具体:只允许jpg文件

# 示例2:复杂的权限控制

Disallow: /wp-content/plugins/ # 禁止插件目录

Allow: /wp-content/plugins/contact-form-7/css/ # 但允许特定插件CSS

# 示例3:WordPress核心文件控制

Disallow: /wp-admin/ # 禁止后台

Allow: /wp-admin/admin-ajax.php # 允许AJAX

Allow: /wp-admin/load-styles.php # 允许样式加载4.3 搜索引擎特定指令

# Google特定指令

User-agent: Googlebot

Disallow: /print/ # 打印版本页面

Allow: /wp-content/uploads/ # 允许Google图片索引

Crawl-delay: 1 # 爬取延迟1秒

# 商品搜索指令

User-agent: Googlebot-News

Allow: /

User-agent: Googlebot-Video

Allow: /

# Bing特定指令

User-agent: Bingbot

Disallow: /cgi-bin/

Disallow: /tmp/

Crawl-delay: 2

# 百度特定优化

User-agent: Baiduspider

Disallow: /wp-admin/

Disallow: /*/comment-page-* # 评论分页

Disallow: /*?replytocom=* # 评论回复链接

Crawl-delay: 5 # 百度建议较长的延迟五、不同WordPress设置的robots.txt优化

5.1 多站点(Multisite)配置

# WordPress多站点robots.txt

# 主站点规则

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-includes/

Allow: /wp-admin/admin-ajax.php

Disallow: /blog/wp-admin/ # 子站点后台

Disallow: /site/wp-admin/ # 另一个子站点

Disallow: /*/wp-admin/ # 所有子站点后台

Allow: /*/wp-admin/admin-ajax.php # 允许所有子站点AJAX

# 子站点特定规则

User-agent: *

Disallow: /blog/wp-admin/

Allow: /blog/wp-admin/admin-ajax.php

Disallow: /blog/wp-includes/

# 主站点站点地图

Sitemap: https://www.example.com/sitemap_index.xml

# 子站点站点地图

Sitemap: https://www.example.com/blog/sitemap_index.xml5.2 WooCommerce电商网站

# WooCommerce网站robots.txt优化

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /cart/

Disallow: /checkout/

Disallow: /my-account/

Disallow: /add-to-cart=*

Disallow: /?add-to-cart=*

Disallow: /wc-api/*

Disallow: /order-pay/

Disallow: /order-received/

Disallow: /lost-password/

Disallow: /reset-password/

# 允许爬取的重要页面

Allow: /shop/

Allow: /product/

Allow: /product-category/

Allow: /product-tag/

# 商品Feed

Sitemap: https://www.example.com/product-sitemap.xml

Sitemap: https://www.example.com/product-category-sitemap.xml

Sitemap: https://www.example.com/product-tag-sitemap.xml

# Google商品搜索优化

User-agent: Googlebot-Image

Allow: /wp-content/uploads/*.jpg

Allow: /wp-content/uploads/*.png

Allow: /wp-content/uploads/*.webp

Disallow: /wp-content/uploads/avatars/5.3 会员制/付费内容网站

# 会员制网站robots.txt

User-agent: *

Disallow: /members/

Disallow: /members-area/

Disallow: /subscription/

Disallow: /payment/

Disallow: /billing/

Disallow: /account/

Disallow: /login/

Disallow: /register/

Disallow: /password-reset/

Disallow: /private/

Disallow: /premium/

Disallow: /restricted/

# 允许公开内容

Allow: /public-content/

Allow: /free-resources/

Allow: /blog/

Allow: /about/

Allow: /contact/

# 保护付费内容

Disallow: /downloads/paid/

Disallow: /courses/paid/

Disallow: /*?member_content=yes

Disallow: /*/paid-version/六、动态robots.txt生成与条件规则

6.1 基于环境的动态robots.txt

<?php

/**

* WordPress动态robots.txt生成

* 根据环境、用户角色、插件状态等条件生成

*/

function dynamic_robots_txt($output, $public) {

$rules = "User-agent: *\n";

// 基础WordPress规则

$rules .= "Disallow: /wp-admin/\n";

$rules .= "Disallow: /wp-includes/\n";

$rules .= "Allow: /wp-admin/admin-ajax.php\n";

$rules .= "Allow: /wp-admin/admin-post.php\n";

// 根据环境调整规则

$environment = wp_get_environment_type();

switch ($environment) {

case 'production':

// 生产环境:宽松规则

$rules .= "Disallow: /staging/\n";

$rules .= "Disallow: /dev/\n";

break;

case 'staging':

case 'development':

// 开发/测试环境:完全禁止爬取

$rules .= "Disallow: /\n";

return $rules;

case 'local':

// 本地环境

$rules .= "# 本地开发环境\n";

$rules .= "Disallow: /\n";

return $rules;

}

// 根据插件状态添加规则

if (class_exists('WooCommerce')) {

$rules .= "# WooCommerce规则\n";

$rules .= "Disallow: /cart/\n";

$rules .= "Disallow: /checkout/\n";

$rules .= "Disallow: /my-account/\n";

$rules .= "Allow: /shop/\n";

$rules .= "Allow: /product/\n";

}

if (class_exists('LifterLMS')) {

$rules .= "# LifterLMS学习管理系统\n";

$rules .= "Disallow: /courses/*/lesson/\n";

$rules .= "Disallow: /dashboard/\n";

}

if (function_exists('bbpress')) {

$rules .= "# bbPress论坛\n";

$rules .= "Disallow: /forums/search/\n";

$rules .= "Disallow: /forums/tag/*/\n";

}

// 根据用户角色(如果是管理员)

if (current_user_can('manage_options')) {

$rules .= "\n# 管理员可见的测试页面\n";

$rules .= "Allow: /test-page/\n";

}

// 站点地图

if (function_exists('wp_sitemap_get_provider')) {

$rules .= "\nSitemap: " . esc_url(home_url('/wp-sitemap.xml')) . "\n";

} elseif (class_exists('Yoast\\WP\\SEO\\Helpers\\Options_Helper')) {

$rules .= "\nSitemap: " . esc_url(home_url('/sitemap_index.xml')) . "\n";

}

return $rules;

}

add_filter('robots_txt', 'dynamic_robots_txt', 10, 2);

?>6.2 基于页面条件的规则

<?php

/**

* 根据页面条件动态生成robots元标签

* 补充robots.txt的不足

*/

function conditional_robots_meta() {

if (is_admin()) {

return;

}

$robots_content = array();

// 默认值

$robots_content[] = 'index';

$robots_content[] = 'follow';

// 根据页面类型调整

if (is_search()) {

$robots_content = array('noindex', 'nofollow');

}

if (is_author()) {

// 作者页面:如果作者文章少,则不索引

$author_id = get_queried_object_id();

$post_count = count_user_posts($author_id);

if ($post_count < 3) {

$robots_content = array('noindex', 'follow');

}

}

if (is_tag() || is_category()) {

// 分类/标签页:如果文章少则不索引

$term = get_queried_object();

if ($term && $term->count < 5) {

$robots_content = array('noindex', 'follow');

}

}

if (is_paged()) {

// 分页页面:不索引第二页及以后

$robots_content = array('noindex', 'follow');

}

if (is_attachment()) {

// 附件页面

$robots_content = array('noindex', 'follow');

}

// 密码保护页面

if (post_password_required()) {

$robots_content = array('noindex', 'nofollow');

}

// 输出robots元标签

if (!empty($robots_content)) {

echo '<meta name="robots" content="' . implode(', ', $robots_content) . '">' . "\n";

}

}

add_action('wp_head', 'conditional_robots_meta');

?>七、SEO优化与最佳实践

7.1 爬虫预算优化

# 优化爬虫预算的robots.txt规则

User-agent: *

# 1. 禁止低价值页面

Disallow: /*?* # 动态参数页面

Disallow: /*/print/ # 打印版本

Disallow: /*/amp/ # AMP页面(如果已规范化)

Disallow: /*/mobile/ # 移动版本

Disallow: /feed/ # RSS源

Disallow: /comments/feed/

Disallow: /*/feed/

Disallow: /*/*/feed/

# 2. 禁止会话ID和跟踪参数

Disallow: /*?sessionid=

Disallow: /*?phpsessid=

Disallow: /*?utm_source=

Disallow: /*?ref=

Disallow: /*?share=

# 3. 禁止重复内容

Disallow: /page/*/ # 分页(除第一页)

Allow: /page/1/

Disallow: /*?orderby= # 排序参数

Disallow: /*?filter= # 过滤参数

# 4. 允许重要内容

Allow: /blog/

Allow: /articles/

Allow: /resources/

Allow: /wp-content/uploads/

# 5. 爬取延迟

Crawl-delay: 2

# 6. 站点地图优先级

Sitemap: https://www.example.com/post-sitemap.xml

Sitemap: https://www.example.com/page-sitemap.xml

# 重要内容站点地图放在前面7.2 网站迁移/改版时的robots.txt

# 网站迁移期间临时robots.txt

User-agent: *

# 阶段1:开发/测试期

# Disallow: / # 完全禁止爬取

# 阶段2:预上线期

Disallow: /old-site/

Disallow: /legacy/

Allow: /wp-admin/admin-ajax.php

Disallow: /cgi-bin/

# 阶段3:正式迁移

# 使用301重定向配合以下规则

Disallow: /old/

Disallow: /previous-version/

Allow: /new-site/

Allow: /current/

# 站点地图(新旧都要)

Sitemap: https://www.example.com/old-sitemap.xml

Sitemap: https://www.example.com/new-sitemap.xml

# 爬取延迟提高

Crawl-delay: 5八、安全与隐私保护

8.1 敏感信息保护

# 保护敏感信息的robots.txt规则

User-agent: *

# WordPress核心保护

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /wp-content/plugins/

Disallow: /wp-content/themes/

Disallow: /wp-config.php

Disallow: /wp-config-sample.php

Disallow: /wp-mail.php

Disallow: /wp-settings.php

Disallow: /wp-signup.php

Disallow: /wp-register.php

Disallow: /wp-login.php

Disallow: /xmlrpc.php

# 用户信息保护

Disallow: /author/

Disallow: /users/

Disallow: /members/

Disallow: /profiles/

Disallow: /user/

# 管理区域

Disallow: /cpanel/

Disallow: /controlpanel/

Disallow: /administrator/

Disallow: /admin/

Disallow: /backend/

# 配置文件

Disallow: /.htaccess

Disallow: /htaccess.txt

Disallow: /web.config

Disallow: /configuration.php

Disallow: /php.ini

Disallow: /config/

# 日志文件

Disallow: /error_log

Disallow: /debug.log

Disallow: /logs/

Disallow: /tmp/

Disallow: /temp/

# 数据文件

Disallow: /database/

Disallow: /backup/

Disallow: /backups/

Disallow: /sql/

Disallow: /*.sql

Disallow: /*.sql.gz

# 敏感目录

Disallow: /private/

Disallow: /secret/

Disallow: /confidential/

Disallow: /internal/

Disallow: /restricted/

# 允许AJAX

Allow: /wp-admin/admin-ajax.php8.2 防止恶意爬虫

# 屏蔽已知的恶意爬虫

User-agent: AhrefsBot

Disallow: /

Crawl-delay: 10

User-agent: SemrushBot

Disallow: /

Crawl-delay: 10

User-agent: MJ12bot

Disallow: /

Crawl-delay: 10

User-agent: DotBot

Disallow: /

Crawl-delay: 10

User-agent: MegaIndex

Disallow: /

User-agent: BlexBot

Disallow: /

User-agent: Ezooms

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: proximic

Disallow: /

User-agent: ZoominfoBot

Disallow: /

User-agent: Mail.RU_Bot

Disallow: /

User-agent: spbot

Disallow: /

User-agent: Yandex

Disallow: / # 如果不需要俄罗斯市场

# 允许必要的爬虫

User-agent: Googlebot

Allow: /

Crawl-delay: 1

User-agent: Bingbot

Allow: /

Crawl-delay: 2

User-agent: Slurp

Allow: /

Crawl-delay: 3九、测试与验证工具

9.1 robots.txt测试代码

<?php

/**

* WordPress robots.txt测试与验证工具

*/

class RobotsTXT_Validator {

/**

* 验证robots.txt语法

*/

public static function validate_syntax($robots_content) {

$errors = [];

$lines = explode("\n", $robots_content);

$line_number = 0;

foreach ($lines as $line) {

$line_number++;

$line = trim($line);

// 跳过空行和注释

if (empty($line) || strpos($line, '#') === 0) {

continue;

}

// 检查基本语法

if (preg_match('/^(User-agent|Disallow|Allow|Crawl-delay|Sitemap):/i', $line)) {

continue; // 语法正确

}

$errors[] = "第{$line_number}行语法错误: {$line}";

}

return $errors;

}

/**

* 检查常见WordPress问题

*/

public static function check_wordpress_issues($robots_content) {

$issues = [];

// 检查是否允许了重要文件

if (strpos($robots_content, 'Allow: /wp-admin/admin-ajax.php') === false) {

$issues[] = '警告: 没有允许/admin-ajax.php,可能影响功能';

}

// 检查是否禁止了敏感目录

$sensitive_paths = ['/wp-admin/', '/wp-includes/', '/wp-config.php'];

foreach ($sensitive_paths as $path) {

if (strpos($robots_content, "Disallow: {$path}") === false) {

$issues[] = "警告: 没有禁止{$path},可能存在安全风险";

}

}

// 检查是否有站点地图

if (strpos($robots_content, 'Sitemap:') === false) {

$issues[] = '建议: 没有站点地图声明';

}

return $issues;

}

/**

* 模拟爬虫解析

*/

public static function simulate_crawler($robots_content, $user_agent, $url) {

$rules = self::parse_rules($robots_content, $user_agent);

$parsed_url = parse_url($url);

$path = $parsed_url['path'] ?? '/';

return self::is_allowed($rules, $path);

}

/**

* 解析robots.txt规则

*/

private static function parse_rules($content, $user_agent) {

$lines = explode("\n", $content);

$rules = ['allow' => [], 'disallow' => []];

$current_agents = ['*']; // 默认所有爬虫

foreach ($lines as $line) {

$line = trim($line);

if (empty($line) || $line[0] === '#') {

continue;

}

list($directive, $value) = array_pad(explode(':', $line, 2), 2, '');

$directive = trim($directive);

$value = trim($value);

switch (strtolower($directive)) {

case 'user-agent':

$current_agents = [$value];

break;

case 'disallow':

foreach ($current_agents as $agent) {

if ($agent === '*' || stripos($user_agent, $agent) !== false) {

$rules['disallow'][] = $value;

}

}

break;

case 'allow':

foreach ($current_agents as $agent) {

if ($agent === '*' || stripos($user_agent, $agent) !== false) {

$rules['allow'][] = $value;

}

}

break;

}

}

return $rules;

}

/**

* 检查URL是否允许访问

*/

private static function is_allowed($rules, $path) {

$allowed = true;

// 检查Disallow规则

foreach ($rules['disallow'] as $pattern) {

if (self::matches_pattern($path, $pattern)) {

$allowed = false;

break;

}

}

// 检查Allow规则(覆盖Disallow)

foreach ($rules['allow'] as $pattern) {

if (self::matches_pattern($path, $pattern)) {

$allowed = true;

break;

}

}

return $allowed;

}

/**

* 模式匹配

*/

private static function matches_pattern($path, $pattern) {

if ($pattern === '') {

return false;

}

if ($pattern === '/') {

return $path === '/';

}

// 简单的通配符匹配

$regex = str_replace(

['*', '$'],

['.*', '$'],

preg_quote($pattern, '/')

);

return preg_match("/^{$regex}/", $path);

}

}

?>

<!-- 在前端添加测试界面 -->

<div class="robots-tester">

<h3>robots.txt测试工具</h3>

<form id="robotsTestForm">

<div>

<label>User-Agent:</label>

<select name="user_agent">

<option value="Googlebot">Googlebot</option>

<option value="Bingbot">Bingbot</option>

<option value="Baiduspider">Baiduspider</option>

<option value="*">All (*)</option>

</select>

</div>

<div>

<label>测试URL:</label>

<input type="text" name="test_url" value="<?php echo home_url('/'); ?>">

</div>

<button type="submit">测试</button>

</form>

<div id="testResult"></div>

</div>

<script>

jQuery(document).ready(function($) {

$('#robotsTestForm').on('submit', function(e) {

e.preventDefault();

$.ajax({

url: '<?php echo admin_url("admin-ajax.php"); ?>',

type: 'POST',

data: {

action: 'test_robots_txt',

user_agent: $('select[name="user_agent"]').val(),

test_url: $('input[name="test_url"]').val()

},

success: function(response) {

$('#testResult').html(response);

}

});

});

});

</script>

<?php

// AJAX处理

add_action('wp_ajax_test_robots_txt', 'ajax_test_robots_txt');

function ajax_test_robots_txt() {

$user_agent = sanitize_text_field($_POST['user_agent']);

$test_url = esc_url_raw($_POST['test_url']);

$robots_url = get_home_url(null, '/robots.txt');

$response = wp_remote_get($robots_url);

if (is_wp_error($response)) {

echo '错误: 无法获取robots.txt';

wp_die();

}

$robots_content = wp_remote_retrieve_body($response);

$allowed = RobotsTXT_Validator::simulate_crawler($robots_content, $user_agent, $test_url);

if ($allowed) {

echo '<div class="success">✅ 允许爬取: ' . esc_html($test_url) . '</div>';

} else {

echo '<div class="error">❌ 禁止爬取: ' . esc_html($test_url) . '</div>';

}

wp_die();

}9.2 在线测试工具推荐

- Google Search Console – Robots.txt测试工具

- Screaming Frog – SEO蜘蛛模拟

- Ahrefs – 网站审核工具

- SEMrush – 网站健康检查

- Robots.txt测试器浏览器扩展

十、常见问题与解决方案

10.1 WordPress特定问题

问题1:WordPress不读取物理robots.txt文件

// 解决方案:强制WordPress使用物理文件

function force_physical_robots() {

// 检查是否存在物理文件

$robots_file = ABSPATH . 'robots.txt';

if (file_exists($robots_file)) {

// 移除WordPress的虚拟robots.txt

remove_filter('robots_txt', 'wp_robots');

// 或者重定向到物理文件

add_action('template_redirect', function() {

if (is_robots()) {

status_header(200);

header('Content-Type: text/plain; charset=utf-8');

readfile(ABSPATH . 'robots.txt');

exit;

}

});

}

}

add_action('init', 'force_physical_robots');问题2:缓存插件影响robots.txt

// 解决方案:排除robots.txt从缓存

function exclude_robots_from_cache($excluded_pages) {

$excluded_pages[] = '/robots.txt';

return $excluded_pages;

}

// WP Rocket

add_filter('rocket_cache_reject_uri', 'exclude_robots_from_cache');

// W3 Total Cache

add_filter('w3tc_config_default_value', function($config) {

$config['pgcache.reject.uri'][] = '/robots.txt';

return $config;

});问题3:CDN不更新robots.txt

# Nginx配置:强制robots.txt不缓存

location = /robots.txt {

add_header Cache-Control "no-cache, no-store, must-revalidate";

add_header Pragma "no-cache";

add_header Expires 0;

# 如果有CDN

add_header CDN-Cache-Control "no-cache";

}10.2 SEO相关问题

问题:robots.txt阻止了重要CSS/JS

# 错误示例:阻止了关键资源

Disallow: /wp-content/

# 这会导致搜索引擎无法看到样式,影响渲染

# 正确示例:精细控制

User-agent: Googlebot

Allow: /wp-content/themes/my-theme/css/

Allow: /wp-content/themes/my-theme/js/

Allow: /wp-content/uploads/

Disallow: /wp-content/plugins/

Disallow: /wp-content/themes/other-theme/

User-agent: *

Disallow: /wp-content/themes/

Allow: /wp-content/uploads/问题:分页内容处理不当

# 不好的做法:完全禁止分页

Disallow: /page/

# 这会阻止搜索引擎发现更多内容

# 好的做法:允许第一页,禁止其他

Disallow: /page/2/

Disallow: /page/3/

Disallow: /page/4/

# ...或使用通配符

Disallow: /page/*/

Allow: /page/1/

# 或者在meta标签中控制

# 在分页模板中添加

# <meta name="robots" content="noindex,follow">十一、监控与维护

11.1 自动监控脚本

<?php

/**

* robots.txt监控与告警系统

*/

class RobotsTXT_Monitor {

private $expected_patterns = [

'must_have' => [

'User-agent: \*',

'Disallow: /wp-admin/',

'Allow: /wp-admin/admin-ajax.php',

],

'must_not_have' => [

'Disallow: /$', // 禁止整个网站

'Disallow: /wp-content/uploads/', // 不应该禁止上传目录

]

];

/**

* 定期检查robots.txt

*/

public function schedule_monitoring() {

if (!wp_next_scheduled('robots_txt_daily_check')) {

wp_schedule_event(time(), 'daily', 'robots_txt_daily_check');

}

add_action('robots_txt_daily_check', [$this, 'daily_check']);

}

public function daily_check() {

$robots_url = home_url('/robots.txt');

$response = wp_remote_get($robots_url, ['timeout' => 30]);

if (is_wp_error($response)) {

$this->send_alert('无法访问robots.txt: ' . $response->get_error_message());

return;

}

$content = wp_remote_retrieve_body($response);

$status_code = wp_remote_retrieve_response_code($response);

// 检查HTTP状态

if ($status_code !== 200) {

$this->send_alert("robots.txt返回异常状态码: {$status_code}");

}

// 检查内容长度

if (strlen($content) < 50) {

$this->send_alert('robots.txt内容过短,可能有问题');

}

// 检查必要规则

foreach ($this->expected_patterns['must_have'] as $pattern) {

if (!preg_match("/{$pattern}/", $content)) {

$this->send_alert("缺少必要规则: {$pattern}");

}

}

// 检查危险规则

foreach ($this->expected_patterns['must_not_have'] as $pattern) {

if (preg_match("/{$pattern}/", $content)) {

$this->send_alert("存在危险规则: {$pattern}");

}

}

// 检查语法

$errors = RobotsTXT_Validator::validate_syntax($content);

if (!empty($errors)) {

$this->send_alert("语法错误: " . implode(', ', $errors));

}

// 记录检查结果

update_option('robots_last_check', [

'time' => current_time('mysql'),

'status' => 'ok',

'content_length' => strlen($content)

]);

}

/**

* 发送告警

*/

private function send_alert($message) {

$admin_email = get_option('admin_email');

$site_name = get_bloginfo('name');

wp_mail(

$admin_email,

"[{$site_name}] robots.txt监控告警",

$message . "\n\n网站: " . home_url() .

"\n时间: " . current_time('mysql')

);

// 记录错误

error_log("robots.txt监控告警: {$message}");

}

/**

* 在后台显示状态

*/

public function admin_dashboard_widget() {

wp_add_dashboard_widget(

'robots_monitor_widget',

'robots.txt状态监控',

[$this, 'display_dashboard_widget']

);

}

public function display_dashboard_widget() {

$last_check = get_option('robots_last_check', []);

echo '<div class="robots-monitor-status">';

if (empty($last_check)) {

echo '<p>⚠️ 尚未进行监控检查</p>';

} else {

echo '<p>✅ 最后检查: ' . esc_html($last_check['time']) . '</p>';

echo '<p>内容长度: ' . esc_html($last_check['content_length']) . ' 字符</p>';

// 测试当前robots.txt

echo '<button id="testRobotsNow" class="button">立即测试</button>';

echo '<div id="testResult"></div>';

}

echo '</div>';

?>

<script>

jQuery(document).ready(function($) {

$('#testRobotsNow').on('click', function() {

$.ajax({

url: ajaxurl,

type: 'POST',

data: {

action: 'test_robots_now'

},

beforeSend: function() {

$('#testResult').html('测试中...');

},

success: function(response) {

$('#testResult').html(response);

}

});

});

});

</script>

<?php

}

}

// 初始化监控

$monitor = new RobotsTXT_Monitor();

add_action('init', [$monitor, 'schedule_monitoring']);

add_action('wp_dashboard_setup', [$monitor, 'admin_dashboard_widget']);十二、总结与最佳实践清单

12.1 WordPress robots.txt最佳实践

- ✅ 必须做的:

- 创建物理robots.txt文件

- 禁止

/wp-admin/和/wp-includes/ - 允许

/wp-admin/admin-ajax.php - 包含XML站点地图URL

- 定期测试和验证

- ✅ 推荐做的:

- 根据网站类型定制规则

- 为不同搜索引擎设置特定规则

- 监控robots.txt变化

- 配合meta robots标签使用

- 设置合理的爬取延迟

- ❌ 避免做的:

- 使用

Disallow: /(除非是开发环境) - 阻止CSS/JS文件

- 忘记更新站点地图URL

- 使用过于复杂的通配符

- 忽视安全警告

- 使用

12.2 维护计划

| 任务 | 频率 | 检查内容 |

|---|---|---|

| 语法检查 | 每月 | 规则语法、路径正确性 |

| 链接测试 | 每月 | 重要URL是否可爬取 |

| 安全检查 | 每季度 | 敏感路径是否被保护 |

| 性能检查 | 每季度 | 爬虫预算优化 |

| 全面审计 | 每年 | 完整规则审查 |

12.3 紧急情况处理

- 意外禁止了整个网站

# 紧急恢复robots.txt User-agent: * Disallow: /wp-admin/ Disallow: /wp-includes/ Allow: / Sitemap: [你的站点地图] - 被黑客修改

- 立即恢复备份

- 检查文件权限(设置为644)

- 扫描恶意代码

- 更改所有密码

- SEO排名下降

- 检查Search Console错误

- 验证robots.txt规则

- 测试关键页面可访问性

- 提交更新的站点地图

通过遵循本指南,你可以为WordPress网站创建一个高效、安全、SEO友好的robots.txt文件,有效引导搜索引擎爬虫,保护敏感内容,并最大化网站的搜索引擎可见性。

湘公网安备43020002000238

湘公网安备43020002000238